Tras el atropello ocurrido hace unos días, calificado como el primer atropello mortal por un vehículo autónomo, han surgido miles de opiniones, comentarios y reacciones al respecto. Ésta se trata de una más, y al igual que todas, es debatible. Entremos en situación.

Uber realizaba sus pruebas de conducción autónoma con un Volvo XC90 de su propiedad en Tempe, Arizona. Obviamente, con su debido permiso y siempre con alguien sentado al volante supervisando y al tanto de cualquier imprevisto que pudiera surgir. Los hechos ocurrieron el domingo por la noche, alrededor de las 22:00 h locales. Las primeras noticias que surgieron hablaban de una ciclista, y hubo un cierto revuelo hasta que se confirmó que la víctima no pedaleaba sino que andaba mientras empujaba su bicicleta junto a ella. Según los medios, la primera versión de la policía también describía el atropello como una aparición repentina del peatón en la mitad de la calzada que hacían prácticamente imposible haber podido evitarlo, tanto para un vehículo autónomo como para un vehículo conducido por un humano circulando aproximadamente a 40 mph, es decir, unos 64 km/h. Sin embargo, ha salido a la luz un video en el que se puede observar cómo ocurrió el atropello, y creo que no ha hecho más que avivar el debate y desmentir hasta cierto punto esas primeras versiones.

Tempe Police Vehicular Crimes Unit is actively investigating

the details of this incident that occurred on March 18th. We will provide updated information regarding the investigation once it is available. pic.twitter.com/2dVP72TziQ— Tempe Police (@TempePolice) March 21, 2018

Como podemos observar, no es verdad que la mujer aparezca repentinamente en la calzada. Se ve que cruza la carretera con aparente tranquilidad y tan siquiera reacciona asustada en un acto reflejo, intentando huir o escapar del atropello, aunque sí es verdad que cruza por un lugar no habilitado para ello. Otro dato que ha revelado el video es la actitud del operador de seguridad de Uber. La impresión que da al ver el vídeo es que distrae la mirada hacia abajo en repetidas ocasiones, probablemente hacia su teléfono móvil, hasta que, de manera repentina, reacciona asustado a un imprevisto ante el cual no le da tiempo a hacer nada. Esto me hace plantear la primera mejora posible para el testeo de todos estos sistemas autónomos. ¿Por qué no se implanta, para evitar la distracción de los operadores de seguridad, un sistema similar al de los controles de los aeropuertos en el que a los agentes de seguridad les aparecen objetos prohibidos que tienen que eliminar de la pantalla para no dejar de prestar atención? ¿O el de los trenes, en los que al maquinista le salta un aviso cada determinado tiempo, el cual, si no recibe respuesta acaba accionando el frenado de emergencia del tren?

Esos son los hechos y es ahora cuando entran en juego las diferentes interpretaciones. Para empezar y aunque es verdad que la chica no cruza de manera repentina la calzada, en cuanto a la visión de la cámara su aparición sí que es bastante inesperada. Por supuesto, que el suceso ocurra por la noche no ayuda a que la visibilidad sea buena, pero mi impresión es que en la zona por la que decide cruzar la viandante hay alguna sombra que impide que se pueda distinguir si hay alguien hasta que las luces de cruce tienen la intensidad suficiente como para alumbrarla directamente. Contrasta con las luces de los faros traseros del coche que se encuentra unos cuantos metros más adelante. Es ahí donde me surge la siguiente pregunta: ¿podía haberse evitado si la bici o la mujer hubieran llevado luces o reflectantes? ¿Hubiesen detectado las cámaras entonces a la mujer y a la bicicleta?

El vídeo ha demostrado que el sistema falló a la hora de detectar al peatón. Podría llegar a aceptarse que las cámaras no fueran capaces de distinguir en la oscuridad, pero desde luego, los equipos LIDAR y los radares tenían que haber sido capaces de detectar el problema a tiempo y haber evitado el atropello. Esto tampoco exime de culpabilidad al peatón puesto que, por mucho que el sistema fallase, con el código de circulación en mano, la culpa es del peatón por cruzar por un lugar indebido. Es probable que se vayan conociendo más datos del atropello en los siguientes días, pues aunque no se le esté dando valor, el hecho de que en el atropello estuviese involucrado un coche autónomo ha dado la posibilidad de obtener una cantidad de datos que dudosamente se hubieran podido recopilar en el caso de un vehículo conducido por un humano.

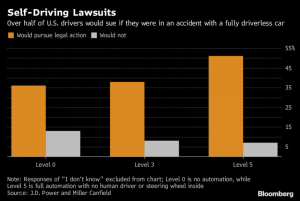

Sin embargo, voy a dejar aquí unas pequeñas reflexiones para recapacitar sobre la movilidad autónoma. Lo primero de todo es la mentalidad de la gente. Es una realidad que la sociedad no está preparada para un cambio tan disruptivo. Por poner un ejemplo: en el mundo ferroviario, Victoria Line, la primera línea de metro autónoma fue inaugurada en Londres en 1969. Sin embargo, seguía teniendo un operario que se encargaba de dar a un botón para abrir y cerrar las puertas o decidir cuándo arrancaba el tren, aunque luego este funcionase de forma automática. En España sólo disponemos de tres líneas autónomas, la 9 y 10 totalmente autónomas y la 11 (con un Técnico de Operación de la Línea A bordo, TOLA) del metro de Barcelona. En un mundo bastante tradicional con una tecnología ya disponible hace más de 40 años, todavía nos sorprende ver trenes sin conductor y los ejemplos apenas llegan a la treintena. Relacionado con el accidente, Bloomberg Technology publicaba una pequeña encuesta tras preguntar a ciudadanos norteamericanos, que más de la mitad tomaría acciones legales si se viesen involucrados en un accidente de tráfico con un vehículo autónomo sin conductor.

Cabe añadir que, según uno de los informes anuales de GHSA (Governors Highway Safety Association), se estima que murieron casi 6.000 peatones en accidentes automovilísticos en Estados Unidos en 2017. El informe es un primer vistazo a las tendencias estatales y nacionales, utilizando datos preliminares provistos por las 50 oficinas estatales de seguridad vial y el Distrito de Columbia. Los Estados informaron de un total de 2.636 muertes de peatones durante los primeros seis meses de 2017. Ajustando los datos basados en tendencias pasadas, GHSA estima que hubo 5.984 muertes de peatones en 2017. Estos datos son parecidos a los que Saúl comenta en su canal de youtube en este video:

Como bien dice Saúl, entre Waymo, Uber y Lyft suman más de 16 millones de kilómetros y acaba de morir una persona por primera vez. Lo que genera estadísticas mucho mejores que la de los humanos. Tal vez el problema para aceptar esta nueva tecnología resida entonces en que medimos la nueva tecnología contra un objetivo falso del 100% de precisión y confiabilidad cuando el estado actual de las cosas ni siquiera está cerca de ese objetivo. Ninguna compañía involucrada en la conducción autónoma ha dicho nunca que vayan a conseguir un sistema perfecto que evite los accidentes siempre. Han defendido que el ratio de accidentes descenderá notablemente, que viajar será más seguro y que por tanto el sistema será más seguro que cuando conducimos los humanos.

Además, medimos los riesgos conocidos de una nueva tecnología contra beneficios desconocidos. Es mucho más fácil anticipar los riesgos de una nueva tecnología que sus beneficios futuros. Los vehículos autónomos proporcionarán una movilidad segura para las personas mayores, discapacitadas y jóvenes, modificando radicalmente su calidad de vida y los riesgos e incomodidades de las opciones actualmente disponibles. El valor social al hacerlo es casi imposible de medir. Además, tendrán un registro irrefutable de cada incidente en el que estén involucrados. Ya no será un juego de adivinanzas para la policía tratando de descifrar qué sucedió en función de la memoria imperfecta de los involucrados o de los testigos. Se obtendrán datos precisos de todos los factores involucrados, no sólo por cuestiones de responsabilidad sino, lo que es más importante, para el aprendizaje. Sin embargo, hasta que eso se convierta en la normalidad, los riesgos conocidos superan con creces los beneficios desconocidos.

Por último, la inteligencia artificial que impulsa vehículos autónomos aprende a base de hacer. Si bien es verdad que la inteligencia artificial puede entrenarse usando simulaciones, donde realmente aprende es en las pruebas reales. Y realizar pruebas reales implica cometer errores y aprender de ellos aunque algunos de esos errores nos aterroricen. Sin embargo, la diferencia entre cómo aprende un vehículo impulsado por inteligencia artificial y cómo aprendemos los humanos es abismal, ya que una vez que la inteligencia artificial aprende algo, la lección se comparte con cada vehículo que use esa misma inteligencia. Eso significa que la velocidad a la que el aprendizaje impacta positivamente en la escala de resultados es mucho mayor que la de la competencia que no somos otros que los conductores humanos. Nunca podremos competir con esto.

Seguirán surgiendo contratiempos y avances, tragedias y triunfos. El accidente de Tempe fue una desgracia, pero el objetivo de la sociedad debe ser reducir radicalmente eso: no estancándonos en lo malo y conocido, sino avanzando hacia el futuro, que en este caso será bueno, pero por conocer.